Picando Código

Reseña: Vultures - Scavengers of Death - Steam

marzo 11, 2026 09:00

Vultures - Scavengers of Death es un juego de survival horror por turnos, con inspiración en clásicos como Resident Evil y Parasite Eve. Los gráficos están estilizados como recuerdo el primer Resident Evil en PlayStation. Se ven bastante poligonales, pero optimizados para pantallas modernas con alta definición. Manteniendo una personalidad retro, con las ventajas que traen muchos años de experiencia y avances tecnológicos en videojuegos.

Me gusta que se aprecie el estilo creado a partir de las limitaciones de hardware de tiempos anteriores. Sobretodo cuando hoy hay mucho menos limitaciones tecnológicas. En materia creativa a veces los límites fomentan la creatividad, y se generan expresiones gráficas clásicas que no pierden vigencia, como ésta. Por cierto, Resident Evil cumple 30 años el próximo Domingo 22 de marzo.

Mi experiencia con Resident Evil es muy reducida. Recuerdo haberlo jugado una vez que fui a la casa del amigo de un amigo donde había un PlayStation 1 conectado a un televisor CRT de 14 o 21 pulgadas. Éramos varios charlando mientras nos íbamos turnando para jugar un poco. Qué buenos tiempos aquellos de adolescente donde andaba callejeando por Maldonado y terminábamos jugando PlayStation en un apartamento y esa memoria vendría a mi cabeza décadas más tarde para reseñar un juego.

En Vultures - Scavengers of Death, la ciudad colapsó tras una explosión en un centro industrial que transformó a la población en zombis. En una metrópolis sellada bajo cuarentena total, asumimos el rol de un agente de la unidad de mercenarios VULTURES. Fuimos contratados para alcanzar la cima de la torre Nakat... Eugenesys y con suerte encontrar una cura.

El juego tiene esa característica opresiva del horror de supervivencia que tenemos que gestionar bien los recursos. La munición es limitada y no tenemos un amplio arsenal de armas para entrar cuarto por cuarto eliminando zombies a diestra y siniestra. También necesitamos recurrir a la estrategia, porque tirarnos de frente contra todo enemigo que nos encontremos no nos va a ayudar a progresar. Los desarrolladores comentaron que tuvieron en cuenta éstos factores, fundamentales en los géneros que combina, a la hora de diseñar armas y equipamiento.

El cazador ciego, una de las "criaturas" de Vultures - Scavengers of Death

Un aspecto particular que puede sonar raro si conocemos los títulos en los que está inspirado, es el combate por turnos. No sé si ya se había hecho un juego así con aspectos de horror de supervivencia. Pero me resultó diferente e interesante. Los desarrolladores hablan bastante del tema en la página de Steam. Ese post en particular nos aporta un montón de información sobre las características del juego y cómo llegaron a ellas.

Su idea es permitirnos tiempo para pensar qué hacer en cada situación, pero también ofrecer algo poco convencional dentro del género. A lo que tenemos acciones limitadas y tiempo, podemos evaluar las opciones y armar una estrategia. Citan a Breach, Colony Ship, Xcom, y Dungeon and Dragons como inspiración para el combate. Todo surgió de hacer un roguelike a lo Resident Evil en una terminal retro de los 80, usando comandos de texto. Así destilaron las mecánicas clave de survival horror y las tradujeron al contexto de un juego de tablero.

Agregan también que consideraron tener niveles generados procedimentalmente. Pero llegaron a la conclusión que no era la mejor opción. Su explicación me parece muy buena, pueden leerla en el enlace anterior.

Estoy de acuerdo que si bien generar los escenarios es técnicamente viable (y en algunos casos agrega mucha variedad), para cierto tipo de juegos es difícil lograr el balance y sensaciones adecuado. Personalmente prefiero algo más "curado", como esto, donde los desarrolladores tienen que definir cada nivel, jugarlo y ver cómo se siente. De repente queda esa opción para más adelante.

El juego está hecho con Godot, el motor de desarrollo de videojuegos multiplataforma software libre. Me encanta ver juegos de calidad hechos con Godot. Está muy bueno ver la variedad de estilos y mecánicas que se pueden lograr con esta herramienta. Ya he comentado que estuve experimentando y desarrollando un poco con Godot, y me gustó bastante lo que pude lograr con relativamente poco estudio y experimentación. Voy a ver si en algún momento vuelvo.

¡Es un juego Colombiano! Está desarrollado por Vultures Team: Mateo y Giovanni son amigos y compañeros con más de nueve años de trayectoria creando juegos y software juntos. Destacan por desarrollar mecánicas experimentales y adoptar un estilo artístico retro y poco convencional. En ocasiones, sus juegos incorporan toques de crítica social y política, cuestionando a menudo la sociedad de consumo y el capitalismo desenfrenado.

He estado jugando la demo en Steam, disponible en varios idiomas incluido el Español. Podemos jugar con Leopoldo, uno de los (al menos dos) personajes disponibles e incluye completa la primera misión.

Nos encontramos en una jefatura de policía, donde irán apareciendo los primeros zombis. La mayoría son oficiales de policía, y los podemos atacar con una pistola, un cuchillo y cócteles molotov. Más adelante podemos obtener una escopeta, que ataca más de un espacio a la vez y empuja a los enemigos. Ideal cuando tenemos un grupo de zombis enfrente.

¡Fuego! ¡Fuego al zombi policía! Mujajajajaja... El molotov es más efectivo para atacar más de un zombi, pero necesitaba probarlo.

A medida que vamos jugando, vamos desbloqueando cosas y se va poniendo más interesante. Las primeras pocas veces que jugué el demo, no lograba engancharme. Moría relativamente rápido y no avanzaba mucho. Pero con unas pocas jugadas más le fui agarrando la mano y disfrutándolo más. Son importantes las palabras de sus desarrolladores sobre la estrategia. Es mejor tomarse un tiempo y ver qué opciones tenemos, que ir adelante y atacar. Cuando lo enfrentaba como un juego de acción, generalmente terminaba viendo la pantalla de partida perdida. Por suerte cuando perdemos, si decidimos continuar, empezamos en la última puerta que atravesamos.

Para ayudar nuestro progreso, vamos a ir encontrando cosas útiles en el camino. Los botiquines de primeros auxilios los podemos usar para curar al personaje, hay computadoras para guardar el progreso y dispensadores de agua que también recuperan un poco de salud.

Nos podemos mover libremente por la grilla de cada cuarto, pero si un zombi nos detecta, entramos en modo combate. En el modo combate tenemos puntos de acción y movimiento limitados para realizar acciones de ataque, movernos, cambiar de lugar con un enemigo, empujar, curarnos y más.

A la hora de explorar, podemos elegir entre tres modos para desplazarnos: caminar, correr y sigilio. A medida que avanzamos aprendemos lo importante de ir usando cada uno. Cuando volvemos por cuartos que sabemos son seguros, o recorremos pasillos, vamos a querer ir corriendo. Luego en general caminando, pero el sigilio va a ser un arma casi que imprescindible. No sólo nos permite evitar la detección por los zombis, también podemos hacer ataques estratégicos. Es importante tener en cuenta la posición y las ventajas que podemos conseguir para evitar que nos dañen. O directamente podemos evitar totalmente el combate, para ahorrar balas y energía.

En esta habitación perdí por enfrentarme a todos los zombies a la vez. Con sigilio me pude ir acercando de a poco a cada uno y apuñalarlos antes que me vieran, dándome un ataque de ventaja. También, las mesas están en posiciones que nos permiten ocultarnos o definir por dónde se van a mover los zombies si nos atacan.

La historia se va a ir descubriendo interactivamente por medio de documentos y otros ítems que revelan qué pasó. Asimismo recolectamos llaves o pistas para abrir distintas puertas que en principio se encuentran bloqueadas. Me resultó imprescindible usar el mouse y teclado a la vez. Se podría jugar sólo con el mouse, pero resulta mucho más práctico ir aprendiéndose los atajos de teclado para cambiar el modo de caminata, el arma, etc. ágilmente.

La demo lleva entre 40 y 50 minutos de juego promedio. Termina cuando llegamos al final del primer nivel en la jefatura. Hicieron un buen trabajo con esto último, la historia se va desenvolviendo y se pone interesante a medida que avanzamos. Para cerrar, vemos que al igual que en Resident Evil, no van a ser sólo zombies los monstruos sueltos. Recomiendo probar la demo, sobretodo si te gusta cualquiera de los títulos nombrados como inspiración. Y ya se puede agregar a la Wishlist de Steam si te interesa.

El juego completo está planeado publicarse en Abril de 2026. Incluirá más niveles y a Amber, una mercenaria aparentemente inspirada en Motoko Kusanagi. Se destaca por sus movimientos rápidos y sigilosos, y cuenta con un gameplay distintivo. Está disponible en Steam para Windows, pero me funcionó perfectamente en Garuda Linux con Proton 10.0.4. Está hecho en Godot, así que salvo que tenga algún componente exclusivo para Windows, de repente el juego completo tiene una versión nativa para Linux.

El post Reseña: Vultures - Scavengers of Death - Steam fue publicado originalmente en Picando Código.

Variable not found

Enlaces interesantes 640

marzo 09, 2026 07:05

Ya he publicado los enlaces a contenidos interesantes que he ido descubriendo a lo largo de la semana pasada 😊

En esta entrega, destacamos el repaso de Martin Stühmer a los errores más comunes en la gestión de sesiones en aplicaciones ASP.NET Core y cómo evitarlos para mejorar su seguridad de nuestras aplicaciones.

Se ha lanzado la versión 1.0 del SDK oficial de MCP para C#. Aún no he tenido tiempo de probarlo, pero así al vistazo parece que puede facilitarnos un poco la vida a la hora de integrar nuestras aplicaciones con modelos de lenguaje y otros servicios de IA.

Y seguimos con más lanzamientos, Jetbrains han anunciado ReSharper para Visual Studio Code, Cursor y editores compatibles. Como fan incondicional de esta herramienta desde hace años, me alegra que ahora esté también disponible más allá de Visual Studio.

Por último, Gerson Azabache nos recuerda la importancia de hacer ejercicio, especialmente para los desarrolladores, que pasamos muchas horas sentados frente al ordenador y a menudo descuidamos nuestra salud física.

Muchos más enlaces a contenidos interesantes, a continuación.

Por si te lo perdiste...

- Gestión centralizada de paquetes NuGet en soluciones y proyectos .NET

José M. Aguilar - Si las shadow properties no existen como propiedades en la entidad, ¿cómo podemos inicializarlas en el seed de Entity Framework Core?

José M. Aguilar

.NET

- Why IEnumerable Can Kill Performance in Hot Paths

Ali Hamza Ansari - Creating case-sensitive folders on Windows using C#

Gérald Barré - Writing a .NET Garbage Collector in C#

Kevin Gosse

ASP.NET Core / ASP.NET / Blazor

- YARP as API Gateway in .NET: 7 Real-World Scenarios You Should Know

Anton Martyniuk - TryParse error when using Minimal APIs

Bart Wullems - How to secure ASP.NET Core APIs with Basic Authentication

David Grace - Stop Re-Entering Your Token in Swagger UI: EnablePersistAuthorization in ASP.NET Core

Juan Luis Guerrero - Rate Limiting IdentityServer Endpoints

Maarten Balliauw - Cleaner Minimal API Endpoints with [AsParameters]

Bart Wullems - Customizing the New ReconnectModal Component in Blazor 10

Héctor Pérez - Your Logout Button Is Lying: ASP.NET Session Security Done Right

Martin Stühmer

Azure / Cloud

- Azure Trusted Signing Revisited with Dotnet Sign

Rick Strahl - Introducing GPT-5.4 in Microsoft Foundry

Naomi Moneypenny

Conceptos / Patrones / Buenas prácticas

- When to Use Factory Method Pattern in C#: Decision Guide with Examples & Prototype Design Pattern in C#: Complete Guide with Examples

Nick Cosentino - Fencing Tokens and Generation Clock in .NET: Stop Zombie Leaders From Writing

Chris Woodruff

Data

- How C# Strings Silently Kill Your SQL Server Indexes in Dapper

Kevin W. Griffin - Managing multiple SQL Server instances from SQL Server Management Studio

Bart Wullems

Machine learning / IA

- GPT-5.3 Instant: conversaciones cotidianas más fluidas y útiles & Introducing GPT-5.4

OpenAI - Decision Trees

Jared Wilber & Lucía Santamaría - So whats the next word, then?

Matthias Kainer - Give Your Agents Domain Expertise with Agent Skills in Microsoft Agent Framework

Sergey Menshykh - Release v1.0 of the official MCP C# SDK

Mike Kistler - Model Context Protocol (MCP): Building AI Integrations in .NET Using the C# SDK

Arulraj Aboorvasamy - MicrosoftDocs/Agent-Skills: Curated Agent Skills for Microsoft & Azure – giving AI coding assistants structured, real-time expertise from Microsoft Learn docs

Microsoft

Web / HTML / CSS / Javascript

- TanStack Query en Angular: caché y rendimiento

David Filipe Lopes - Announcing TypeScript 6.0 RC

Daniel Rosenwasser - Popover API or Dialog API: Which to Choose?

Zell Liew - Navigation API - a better way to navigate, is now Baseline Newly Available

Ray Rungta - The Odometer Effect (without JavaScript)

Preethi Sam - New to the web platform in February

Rachel Andrew - Quick tip: hosting HTML/CSS/JS demos from source code on GitHub Pages

Christian Heilmann - You can use newline characters in URLs

Daniel Lemire - Security Advisory: Addressing Recent Vulnerabilities in Angular

Angular Team - Sticky Grid Scroll: Building a Scroll-Driven Animated Grid

Theo Plawinski - Singleton or Not? Understanding Angular Services

Dhananjay Kumar - The Different Ways to Select <html> in CSS

Daniel Schwarz - The Big Gotcha of Anchor Positioning

Chris Coyier

Visual Studio / Complementos / Herramientas

- From idea to pull request: A practical guide to building with GitHub Copilot CLI

Ari LiVigni - ClockTray – Hide or Show Your Windows Clock with One Click (yes, in C#)

Bruno Capuano - ReSharper for Visual Studio Code, Cursor, and Compatible Editors Is Out

Sasha Ivanova & Alexander Kurakin

.NET MAUI

- How to Stream Real-Time Data into a .NET MAUI DataGrid Using Firebase

Shalini Suresh - .NET 10: Secondary Toolbar Items for iOS, macOS in .NET MAUI

Leomaris Reyes

Otros

- ¿Quieres programar mejor? Empieza por entrenar tu cuerpo

Gerson Azabache Martínez - Crawling a billion web pages in just over 24 hours

Andrew Chan

Publicado en Variable not found.

Variable not found

C# bizarro, episodio 7: crisis de identidad

marzo 06, 2026 03:38

Vamos con una entrega más (siete llevamos ya) de la serie C# bizarro, estos divertidos posts donde ponemos a prueba nuestros conocimientos del lenguaje mientras exploramos algunas de sus características extrañas o poco conocidas.

En esta ocasión, os propongo que le echéis un vistazo al siguiente código, en especial a su método ChangeIdentity(), que pretende cambiar la identidad de una persona por la de otra que le llega como parámetro:

var john = new Person() { Name = "John" };

var peter = new Person() { Name = "Peter" };

john.ChangeIdentity(peter);

Console.WriteLine(john.Equals(peter));

struct Person

{

public string Name;

public void ChangeIdentity(Person otherPerson)

{

this = otherPerson; // WFT!?!?

}

}

En efecto, en el cuerpo del método estamos asignando un nuevo valor a this. ¿Pensáis que esto compilará? Y en caso afirmativo, ¿qué veríamos en la consola al ejecutarlo, true o false?

El código, efectivamente, compila sin problema. Aunque la asignación de this pueda parecer extraña, es perfectamente válida en C# porque estamos en el interior del método de instancia de una estructura. No compilaría, en cambio, si Person fuera una clase.

Esto se debe a que internamente las estructuras son tipos valor, por lo que this representa una copia completa del valor de la estructura en memoria. Al asignar this = otherPerson, estamos copiando el valor de otherPerson sobre this, lo que en la práctica significa que estamos copiando el valor de todos los campos de la estructura origen sobre la actual, aunque sin tener que hacerlo de forma manual 🙂

En clases, sin embargo, this es una referencia (o puntero) inmutable a la instancia del objeto en memoria, por lo que no se puede reasignar para ponerla apuntando a otro objeto.

Ahora vamos con la segunda parte de la pregunta, ¿qué veremos en la consola al ejecutar el código que utiliza el método ChangeIdentity()?

var john = new Person() { Name = "John" };

var peter = new Person() { Name = "Peter" };

john.ChangeIdentity(peter);

Console.WriteLine(john.Equals(peter));

Seguro que habéis adivinado que la respuesta es true. Fijaos que si hubiésemos utilizado clases en lugar de estructuras, el resultado habría sido false, ya que john y peter serían punteros a objetos distintos en memoria y la igualdad por referencia nunca sería cierta. Pero al ser estructuras, la comprobación de igualdad se realiza por valor, es decir, comparando los valores de todos sus campos.

Y dado que anteriormente hemos copiado los valores de todos los campos de peter sobre la estructura john, ambos objetos son idénticos en memoria y, por tanto, la operación de comparación devuelve true.

Qué, ¿lo habíais adivinado? 😄

Publicado en Variable not found.

Navegapolis

Legado digital

marzo 05, 2026 12:09

Explorando cómo programar con IA, el episodio “La muerte digital” del podcast DECODE de Dani Sánchez-Crespo (DaniNovarama) me dio la idea de hacer un programa para el reto que plantea: ¿qué pasa con tus contraseñas, seguros, accesos bancarios y documentos privados si un día no estás? ¿Cómo puede acceder tu familia?

Así que aprovechando la fiesta del 5 de marzo (para eso hay que ser de Zaragoza  )este es el resultado: Legado Digital: un único ejecutable que se puede guardar en un pendrive, sin instalación. Almacena la información cifrada con AES-256-GCM y Argon2id.

)este es el resultado: Legado Digital: un único ejecutable que se puede guardar en un pendrive, sin instalación. Almacena la información cifrada con AES-256-GCM y Argon2id.

Esta es la información de lo que he usado, y la aplicación, por si os puede ser útil:

He usado:

- Antigravity coon Gemini3.1 Pro.

- Go para el motor de seguridad.

- base de datos SQLite (en memoria)

- Svelte + TailwindCSS para la interfaz

- Wails v2 para empaquetarlo todo en un único binario de Windows.

El programa lo podéis descargar en el enlace de abajo que tiene el ejecutable y un txt de instrucciones, que comparto tal cual, sin compromisos de licencia ni mantenimiento para los que os pueda resulta útil.

La entrada Legado digital se publicó primero en Navegápolis.

Variable not found

Enlaces interesantes 639

marzo 02, 2026 07:01

Una semana más, vamos con los enlaces a contenidos interesantes que he ido recopilando durante estos días, entre los que destaco algunos posts.

Juan Irigoyen comparte sus experiencias utilizando IA para optimizar SQL Server, en un interesante recorrido por la preparación de un agente Claude capaz de analizar y optimizar consultas SQL, con resultados bastante prometedores.

La depuración puede ser una labor compleja, intensa, a veces frustrante y otras gratificante, pero sin duda forma parte de nuestro día a día. En este artículo, Jeremy D. Miller reflexiona sobre el proceso de depuración, compartiendo consejos para abordar los problemas de manera efectiva-

Y para terminar, una frikada épica a la que llego a través de Microsiervos: un procesador x86 completo implementado únicamente con CSS, sin una sola línea de código JavaScript, y que es capaz de ejecutar código ensamblador compilado para ese procesador.

El resto de contenidos interesantes, a continuación.

Por si te lo perdiste...

- Trocear predicados para mejorar la legibilidad

José M. Aguilar - Shadow properties en Entity Framework Core

José M. Aguilar

.NET

- Logging Profesional en .NET con Serilog: Minimalismo Bien Hecho

Gerson Azabache Martínez - When to Use Builder Pattern in C#: Decision Guide with Examples

Nick Cosentino - A smarter way to learn .NET without reading the docs

David Grace - .NET 11 Preview 1 Arrives with Runtime Async, Zstandard Support, and C# 15 Features

Almir Vuk - Recording metrics in-process using MeterListener

Andrew Lock - Cleaner switch expressions with pattern matching in C#

Bart Wullems - Vector Data in .NET - Building Blocks for AI Part 2

Jeremy Likness - Is it faster to index into an array or use switch statement for lookups?

Jiří Činčura - Semantic Kernel in C#: Complete AI Orchestration Guide

Nick Cosentino - .NET Synchronisation APIs - Part 1

Ricardo Peres - Brave new C#

PVS-Studio - Developing an MCP Server with C#: A Complete Guide

NDepend Team

ASP.NET Core / ASP.NET / Blazor

- Cookie Banners Won't Save You From ISO 27701

Martin Stühmer - Stop Wrestling with JavaScript: htmxRazor Gives ASP.NET Core the Component Library It Deserves

Chris Woodruff

Azure / Cloud

- How to Troubleshoot Azure Functions Not Visible in Azure Portal

Vikas Gupta - Optimising AI Costs with Microsoft Foundry Model Router

Lee Stott

Conceptos / Patrones / Buenas prácticas

- Rename, para entender mejor

Fran Iglesias - Read Replicas Are NOT CQRS (Stop Confusing This)

Peter Ritchie - How to Avoid Code Duplication in Vertical Slice Architecture in .NET

Anton Martyniuk - TDD as induction

Mark Seemann - On Debugging Problems

Jeremy D. Miller

Data

- Optimización en Sql Server usando IA

Juan Irigoyen - Emulating GETDATE() on Azure SQL Database

Joe Obbish - Polymorphic Relationships in EF Core: Three Approaches

Ali Hamza Ansari - The Hidden Work Behind SELECT TOP in SQL Server

Jared Westover

Machine learning / IA

- Primeros pasos con Microsoft Agent Framework: construyendo un chatbot de soporte con C#

Isaac Ojeda - Microsoft Agent Framework is Release Candidate! Let’s Go

Bruno Capuano - Redefining the Software Engineering Profession for AI

Mark Russinovich & Scott Hanselman - [TIP] How to Add MCP Servers to Claude Code and Gemini CLI on Windows

Juan Luis Guerrero

Web / HTML / CSS / Javascript

- Playing CSS-defined animations with JavaScript

Ben Hatsor - Loading Smarter: SVG vs. Raster Loaders in Modern Web Design

Mariana Beldi - Virtual Scroll-Driven 3D Scenes

Gunnar Bachelor - Goodbye innerHTML, Hello setHTML: Stronger XSS Protection in Firefox 148 - Mozilla Hacks

Tom Schuster, Frederik Braun & Christoph Kerschbaumer - A Complete Guide to Bookmarklets

Declan Chidlow - An Exploit ... in CSS?!

Lee Meyer - A Guide to Jakob’s Law in Web Development

Adrew Peterson - React 19 Suspense for Data Fetching: A New Model for Async UI

Prashant Yadav - We deserve a better streams API for JavaScript

James M. Snell - Yet Another Way to Center an (Absolute) Element

Juan Diego Rodríguez - The Hidden Trick of Style Queries and if()

Temani Afif - Building Async Page Transitions in Vanilla JavaScript

Valentin Mor

Visual Studio / Complementos / Herramientas

- cURL para desarrolladores .NET: guía práctica, real y profesional

Gerson Azabache Martínez - GitHub Copilot CLI is now generally available

GitHub Copilot Team - The Dongle Died at Midnight – WinForms Agent Saved my German Mom's Business Trip

Klaus Loeffelmann - Introducing Agentic UI Builder: Build Complete Enterprise UIs with Syncfusion MCP Servers

Lokeshwaran Ragavan - Run OpenClaw Securely in Docker Sandboxes

Oleg Selajev - XAML.io v0.6: Share Running .NET Code With a Link

XAM.io Team - Stop Drawing Architecture Diagrams Manually: Meet the Open-Source AI Architecture Review Agents

Shivam Goyal - VS Code: Building Long-Distance Next Edit Suggestions

Vikram Duvvur, Gaurav Mittal & Benjamin Simmonds

.NET MAUI

- Simplifying Grid Layout in .NET MAUI Using Extension Methods

Leomaris Reyes - C# Expressions in XAML: throw out your converters

Steven Thewissen - How to Add Email and Toast Reminders to a .NET MAUI Scheduler

Yuvaraj Gajaraj

Otros

- What is egoless programming?

Ivan Kranjec - x86 CPU made in CSS

Lyra Rebane

Publicado en Variable not found.

Picando Código

Migrando código de GitHub a Codeberg

febrero 26, 2026 12:00

Sigo con mi migración a un uso más sano de internet, computadoras, la vida, el universo y todo lo demás. Además de estar alojando mi servidor Git con Forgejo, también empecé a migrar mis cosas de GitHub a Codeberg. Mi idea es por lo menos todos mis proyectos personales irlos borrando de GitHub. Voy a tenerlos tanto en Codeberg como mi instancia local privada de Forgejo.

Eventualmente éstos sistemas van a implementar la federación. Ahí buscaré una forma de alojar mi propia instancia en algún servidor remoto. Me gusta mucho la idea de tener una instancia propia y personal. Y desde ahí compartir mi código de manera pública y colaborar con código abierto y software libre. Haría el trabajo que hacía GitHub, pero de forma autónoma y sin el veneno de Microslop encima.

Voy bastante lento, sinceramente es un trabajo aburrido y monótono. Además después de pasar todo el día trabajando (gran parte de eso interactuando con GitHub), me quedan pocas ganas a la tarde/noche de seguir haciendo eso. Pero va saliendo.

Muchos de los repositorios los he ido compartiendo acá en el blog, así que tengo que ir buscando los enlaces para cambiarlos a su dirección nueva y guardar los posts o comentarios. Ya he cambiado algunos y borrado los repositorios enteros de GitHub. No me interesa qué registro quede en mi perfil de GitHub de lo hecho en el pasado, ya no va a ser mi perfil por defecto de código abierto en internet.

Tengo un par de cosas alojadas en GitHub Pages que voy a tener que sacar de ahí. Es todo contenido estático, así que es fácil moverlas a un servidor web común (incluso el mismo servidor donde está alojado este blog). Por cada uno tengo que buscar un hogar nuevo y cambiar dónde apunta el dominio.

El otro tema es la automatización. Las acciones de GitHub son bastante convenientes (cuando funcionan) a la hora de automatizar (excepto a la hora de querer testearlas). Creo que Codeberg tiene algo compatible con eso, pero no lo he revisado. Lo único automatizado que tengo es mi sitio web personal. Es un sitio estático generado con Middleman, pero tiene un montón de contenido que se obtiene dinámicamente. Por eso tengo una acción que actualiza el sitio automáticamente. De repente lo muevo a un servidor y programo un cron en mi Raspberry Pi para que lo genere y suba los archivos por FTP como en los viejos tiempos.

Desde que lo compró Microslop, GitHub se ha ido transformando en un producto cada vez peor. ¡Como todo lo que toca Microslop! Lamentablemente voy a tener que seguir usando GitHub, en el trabajo particularmente hacemos casi todo alrededor de GitHub. Lo cual tiene sentido, como he dicho anteriormente, mi teoría es que GitHub va a ser a Git lo que Jira es a gestión de proyectos. Lo van a terminar usando empresas a las que convencieron que necesitan comprar este producto para hacer desarrollo de software. También voy a mantener por ahora un mirror de mi plugin de WordPress, hasta que vea de coordinar con el otro mantenedor para mudarlo a Codeberg.

Además de todos los problemas éticos que tengo con GitHub, la aplicación está cada día está más inusable. Leí algo de que lo llenaron de React y esto hace que todas las interacciones sean lentas y poco confiables. Además Microslop viene acosándonos con Clippy (ahora con el nombre de copiloto) cada vez más. Esta gente no entiende que no es no.

Cualquier proyecto personal nuevo de código abierto en el que trabaje ya lo voy a tener alojado directamente en Codeberg, pero mientras sigo lentamente migrando de a pocos proyectos por semana...

El post Migrando código de GitHub a Codeberg fue publicado originalmente en Picando Código.Variable not found

Enlaces interesantes 638

febrero 23, 2026 07:02

Otra semana de contenidos interesantes en la web 🙂

Según Milan Milanović, solo 3–4 horas al día son realmente productivas al programar, porque el resto del tiempo se pierde por límites cognitivos, reuniones e interrupciones. Si conseguimos optimizar ese tiempo, mejorará nuestro rendimiento y la calidad del software que desarrollemos, mucho más que intentar trabajar más horas.

Bruno Capuano nos habla sobre la generación de embeddings, tanto de texto como de imágenes, en nuestro equipo local, y nos presenta una biblioteca de código abierto que ha desarrollado para facilitar esta tarea en .NET.

¿En qué se diferencian las colecciones Readonly de las Immutables? ¿Y qué son las colecciones Frozen? Pues aunque parezcan lo mismo, Davide Bellone nos muestra que son cosas muy diferentes.

La primera preview de .NET 11 ya trae algunas novedades interesantes. Steven Giesel nos muestra que el nuevo runtime async es una realidad, y que va a mejorar mucho el rendimiento de las aplicaciones asíncronas.

El resto de enlaces a contenidos interesantes, a continuación.

Por si te lo perdiste...

- Propiedades semi-automáticas en C#

José M. Aguilar - Evaluación en cliente de EF Core: sus peligros y cómo evitarla

José M. Aguilar

.NET

- Logging profesional en .NET: Diseña Telemetría, no Prints

Gerson Azabache Martínez - Collection Expression Arguments in C# 15 are "out"

Steven Giesel - Writing a native VLC plugin in C#

Martin Finkel - Introducing the Coding Agent Explorer (.NET)

Tore Nestenius - New runtime async is hitting .NET 11

Steven Giesel - Exploring .NET 11 Preview 1 Runtime Async: A dive into the Future of Async in .NET

Laurent Kempé - How to Implement Abstract Factory Pattern in C#: Step-by-Step Guide

Nick Cosentino - Creating standard and "observable" instruments

Andrew Lock - Readonly vs Immutable vs Frozen in C#: differences and (a lot of) benchmarks

Davide Bellone - Deep C# - Multicast Delegates and Events

Mike James - T4 templates on modern .NET

Ian Griffiths - Getting Started with .NET Scheduling in Hangfire

Peter Ritchie - NuGet Packages: The Suppliers You Forgot to Audit

Martin Stühmer

ASP.NET Core / ASP.NET / Blazor

- Swagger's missing in .NET 10

David Grace - What's new for the Microsoft Fluent UI Blazor library 4.14

Vincent Baaij - Add application security to the swiyu generic management verifier APIs using OAuth

Damien Bowden - ASP.NET Core with Needlr: Simplified Web Application Setup

Nick Cosentino - How to Set Up Production-Ready Monitoring With ASP.NET Core Health Checks

Anton Martyniuk - Creating Drag-and-Drop ListBoxes in Blazor

Héctor Pérez - Building Real-World Web Apps with ASP.NET Core Razor Pages

David Ramel

Azure / Cloud

Conceptos / Patrones / Buenas prácticas

- Timsort Algorithm

Neo Kim

Data

- SQL Server Long-Running Query Detection: How to Find and Monitor Slow Queries

Edward Pollack - ASP.NET Core warmup EF Core

Karen Payne

Machine learning / IA

- Presentamos GPT‑5.3‑Codex‑Spark

OpenAI - Gemini 3.1 Pro: Announcing our latest Gemini AI model

Gemini Team - Local Embeddings in .NET — The Easy Way & Building RAG in .NET with Local Embeddings — 3 Approaches, Zero Cloud Calls & * Local Image Embeddings in .NET — CLIP + ONNX

Bruno Capuano - The Most Popular AI Tools: What Developers Use and Why

Conrad Schwellnus - WebMCP – a much needed way to make agents play with rather than against the web

Christian Heilmann - I Intercepted 3,177 API Calls Across 4 AI Coding Tools. Here's What's Actually Filling Your Context Window.

Lars de Ridder - Decision Tree Regression from Scratch Without Pointers or Recursion Using C#

James McCaffrey - Microsoft Agent Framework Reaches Release Candidate

Shawn Henry - Migrate your Semantic Kernel and AutoGen projects to Microsoft Agent Framework Release Candidate

Dmytro Struk & Shawn Henry

Web / HTML / CSS / Javascript

- Accesibilidad web 2026: WCAG 2.2, IA y ley europea

Marco Romero - Performance-Optimized Video Embeds with Zero JavaScript

Stefan Bauer - jQuery 4.0.0 Support: What’s New + Kendo UI Has You Covered

Nikolay Penev - Fun with TypeScript Generics

Adam Rackis - Anchored Menus and a Lesson in Scoping

Chris Coyier - Optimizing JavaScript for the Edge Runtime

Jonathan Gamble - Justifying text-wrap: pretty

Alex Kladov - Choosing a React Animation Library: Performance Trade-Offs in Real Apps

Sumankumar G. - Spiral Scrollytelling in CSS With sibling-index()

Lee Meyer - Interop 2026

Geoff Graham - New to the web platform in January

Rachel Andrew - Three Plug-N-Play CSS Libraries

Raymond Camden - Distinguishing "Components" and "Utilities" in Tailwind

Zell Liew - Angular 21: Internal Mechanics, ARIA, and AI-Powered Coding!

Angular Team - API Security Best Practices: A Developer’s Guide to Protecting Your APIs

The Postman Team - Potentially Coming to a Browser :near() You

Daniel Schwarz - Death to Scroll Fade!

Chris Coyier

Visual Studio / Complementos / Herramientas

- Tus contenedores no son tan seguros como crees: estrategias de mitigación para Docker y Kubernetes

CampusMVP - Dear Copilot, can you help me with SQL?

Thiago Henrique da Silva

.NET MAUI

- .NET 11 Preview for .NET MAUI: Simplify XAML with Inline C# Expressions

Sri Radhesh Nag Subash Sankar

Otros

- Autómatas victorianos, gargantas de cuero y redes neuronales: Anatomía secreta de las máquinas parlantes

María Gómez - You can code only 4 hours per day. Here’s why.

Milan Milanović - SaaSpocalipsis: el mercado ya ha descontado algo que muchos desarrolladores aún no han interiorizado

Alberto Díaz Martín

Publicado en Variable not found.

Picando Código

Reus 2 + DLC Praderas - Steam

febrero 19, 2026 07:00

Uno es el universo, eterno, sólo, aburrido. Hasta que una chispa de vida se manifiesta a través de muchas voces con el nombre de Humanidad. Son ambiciosos y acuden a ti buscando ayuda, te llaman Naturaleza. Motivado por su creatividad, creas gigantes elementales que te ayuden a darle forma al mundo. Ayudando a los humanos con sus ambiciones, comienza un nuevo capítulo para proveeer de vida al universo.

Con esta introducción majestuosa comienza la aventura en Reus 2, un juego de estrategia y simulación que nos pone en el lugar de una deidad al mando del sistema solar. Cada partida nos presenta con un planeta desolado que tenemos que terraformar para hacer habitable. Inicialmente tenemos 3 gigantes elementales disponibles, pero a medida que avanzamos en el juego vamos habilitando gigantes nuevos. También está la posibilidad de habilitar todo desde un principio, pero en lo personal preferí ir descubriendo cada recurso nuevo a medida que juego.

Cada gigante permite terraformar un bioma distinto: océano, selva, bosque, desierto, pradera, sabana y más. A su vez, son los encargados de agregar flora, fauna y minerales al planeta. Inicialmente tenemos una tribu o grupo, pero a medida que avanzamos van a mudarse más humanos, y tenemos que crear un hábitat para cada uno. Cada bioma permite flora, fauna y minerales distintos, aunque algunos están disponibles en más de un bioma. En el océano tenemos algas, peces, en la tierra árboles con frutos como arándanos y bananas, conejos y carpinchos, entre otros.

Dependiendo de las necesidades de cada grupo humano, tenemos que equilibrar el medio ambiente con estas bióticas para proveer tecnología, riqueza, alimento y biodiversidad. Reus 2 tiene un montón de cosas por aprender. Pero el juego mismo reconoce que es imposible aprender todo al mismo tiempo, así que aconseja ir aprendiendo a nuestro tiempo. Casi todo tiene un tooltip con explicaciones. La primera misión es un tutorial que resulta bastante esencial y nos enseña lo básico. No hay que agobiarse, a medida que vamos jugando más, le vamos agarrando más la mano y aprendiendo cómo gestionar mejor el planeta.

Hay muchos factores a tener en cuenta y esto hace que sea importante la estrategia que vamos desarrollando con la experiencia. A medida que avanzamos y habilitamos nuevas características, aumenta un poco la complejidad. En algunos momentos se siente como un juego de puzzles tratando de equilibrar los distintos recursos de cada bioma para proveer a cada civilización lo que requiere para prosperar. Pero es muy entretenido y tiene ese factor adictivo de juegos de simulación similares. Es muy satisfactorio completar un planeta e ir viendo cómo avanzamos y nuestro sistema solar se va poblando de más planetas.

Está divertido el loop de empezar un planeta nuevo, jugar y avanzar en las distintas épocas hasta dar por terminado un planeta. Al final recibimos recompensas en relación a las metas que superamos y cómo ayudamos a los humanos. Podemos empezar un planeta de nuevo con lo aprendido y las especies, habilidades o hasta gigantes nuevos a probar. Esto resulta bastante liviano, y como todo juego de estrategia podemos probar cosas distintas para obtener resultados variados en cada nuevo intento.

Cuando tenemos más de un grupo de humanos, empiezan a interactuar entre sí. A veces hacen trueque y generan amistad entre ellos. Otras veces deciden atacarse o robarse recursos entre sí. En esos momentos podemos no intervenir y dejar que se peleen entre ellos. Pero también podemos despertar el espíritu kaiju de nuestros gigantes elementales y eliminar al grupo conflictivo con catástrofes naturales como un tsunami. Las animaciones de los humanos son bastante entretenidas y con mucha personalidad, tanto cuando encuentran cosas nuevas como cuando interactúan entre ellos o son atacados por una catástrofe.

Si los humanos se enojan, pueden llegar a querer atacar a nuestros gigantes elementales. Podemos aceptarlo o enseñarles una lección, enviando un terremoto, fuego y otros desastres naturales para mostrarles quién manda. Es muy divertido, y cuando iniciamos un ataque la música cambia a algo bien dramático que esperaríamos de una película de ataque de monstruos gigantes.

El arte del juego está muy bueno, la fauna, flora, y minerales se van haciendo reconocibles y con el tiempo vamos a tener que ir aprendiendo más por cada bioma. Los diseños de los gigantes elementales me gustan, representativos de sus biomas y con apariencia de amables y bonachones. Pero donde nos hagan enojar, los podemos hacer comportar como verdaderos monstruos. Me gusta el estilo tranquilo y relajante del juego, por eso cuando los humanos se ponen violentos respondo con todo el poder elemental de los gigantes

Recientemente se lanzó el tercer DLC para Reus 2 Praderas. Este incluye:

- Nuevo bioma - Estepa, con un aspecto renovado para el Gigante Jangwa y más de 65 nuevas especies de flora y fauna, como el Bisonte y el Perro de las Praderas.

- Nueva mecánica de incendios, donde el estrés del suelo provoca fuegos que generan efectos en cadena, fortaleciendo y regenerando la naturaleza.

- 4 nuevos líderes: Agricultor, Cultista, Arquitecto y Astronauta, cada uno con estilos de juego únicos.

- 3 nuevas eras: Ciudad Fabulosa, Planeta Celestial y Sueño Biocinético, que abren caminos inéditos para la evolución de la humanidad.

La verdad que estos DLC están bastante completos, le agregan un montón de diversidad y son una buena razón para volver a jugarlo.

El juego está disponible en Steam, Nintendo Switch y XBox. En Steam está publicado en Windows, pero lo he estado jugando con Proton 10.0-4 en Garuda Linux y funciona perfecto. También está verificado como compatible con Steam Deck. Es un juego de estrategia muy entretenido al que vale la pena volver para jugar "un planeta más".

El post Reus 2 + DLC Praderas - Steam fue publicado originalmente en Picando Código.Navegapolis

BurlaBurlando

febrero 18, 2026 06:51

Para desaprender cómo se hacen (o hacían) las cosas sin IA, esta Navidad estuve jugando a hacer un programa con un asistente.

La idea era construir algo para retar y evaluar: la capacidad de un asistente al trazar y ejecutar planes de codificación, y la capacidad de comprensión léxica y razonamiento lógico de los LLM’s.

He empleado:

– Codificación: Antigravity con Gemini 3 Pro (High)

– Imágenes: ChatGPT 5.2 Thinking

– Retos de razonamiento y léxico que muestra el juego: Gemini 3 Pro (High)

– Asesoramiento para levantar y configurar un servidor AWS lihthsail: ChatGPT 5.2 Thinking

Me ha parecido increíble (y creo que también inquietante) el «aumento» que esto puede dar a alguien que tenga conocimientos básicos (fui programador -no muy bueno- y hace más de 20 años).

Por si además puede ser útil  dejo el resultado en burlaburlando.com (el dominio de un proyecto que nunca hice).

dejo el resultado en burlaburlando.com (el dominio de un proyecto que nunca hice).

Toda la codificación, preguntas y retos lógicos que genera, los ha desarrollado una IA.

La entrada BurlaBurlando se publicó primero en Navegápolis.

Variable not found

Lambdas estáticas en C#: cómo y cuándo usarlas

febrero 17, 2026 07:05

No es algo que se utilice habitualmente, y a veces incluso es un detalle desconocido por los desarrolladores, pero las funciones lambda de C# pueden ser estáticas. Y no es porque sea algo nuevo, pues esta característica se introdujo en la versión 9.0 del lenguaje en 2020... simplemente son esos pequeños detalles que se van añadiendo al lenguaje sin hacer mucho ruido, y que a veces pasan desapercibidos.

De hecho, el uso de lambdas estáticas puede ayudarnos a escribir un código más seguro y predecible, además de tener cierto impacto en el rendimiento de nuestras aplicaciones, por lo que merece la pena conocerlas y saber cuándo y cómo usarlas.

En este post vamos a ver qué son las lambdas estáticas, cómo se implementan y cuándo y por qué deberíamos usarlas.

Lambdas estáticas

Al igual que ocurre con los métodos o funciones en C#, las funciones lambda pueden ser estáticas, es decir, pueden vivir fuera del contexto de una instancia de clase, y se implementan simplemente añadiendo la palabra clave static delante de la definición de la lambda:

var suma = static (x, y) => x + y;

Esto mismo podemos verlo en escenarios más complejos, como en consultas LINQ sobre colecciones u orígenes de datos, ya sea usándolas como delegados o bien como árboles de expresión:

int[] nums = [1, 2, 3, 4, 5];

var sum = nums.Where(static x => x % 2 == 0).Sum(); // Suma los pares

Console.WriteLine(sum); // Imprime 6

En cualquier caso, la declaración de una lambda como estática hace que aparezcan ciertas restricciones en su implementación. En primer lugar, las lambdas estáticas no pueden capturar variables de instancia, pues no tienen acceso a this ni a las variables o métodos de instancia de la clase en la que se definen.

Tampoco pueden capturar variables locales ni parámetros del método que las contiene, a menos que se pasen explícitamente como argumentos.

En otras palabras, deben ser funciones puras, que dependen únicamente de sus parámetros de entrada.

Esto, que a priori puede parecer una limitación, en realidad es una de las principales ventajas de las lambdas estáticas, ya que, al no depender de ningún factor externo, su comportamiento será más predecible y fácil de implementar y depurar.

Observa por ejemplo el siguiente caso, en el que la lambda duplicate captura la variable factor del contexto que la contiene, y hace que su valor dependa de ella:

int factor = 2;

var duplicate = (int x) => x * factor; // No captura el valor de 'factor',

// sino la referencia a la variable

Console.WriteLine(duplicate(2)); // Imprime 4

factor = 3;

Console.WriteLine(duplicate(2)); // Imprime 6

Fíjate que aunque llamamos a la lambda duplicate con el mismo parámetro, el resultado es diferente porque la variable factor ha cambiado su valor en el segundo caso.

Esto puede provocar errores difíciles de detectar y depurar. De hecho, el entorno de desarrollo (IDE) nos avisa de que la lambda está capturando una variable del contexto cuyo valor es modificado, por lo que puede provocar efectos inesperados:

Al convertir la lambda en estática, el compilador nos avisará de que no puede capturar variables del contexto, por lo que nos veremos obligados a usar constantes o bien a pasar los valores como parámetros; en cualquiera de los dos casos, la lambda será siempre una función pura y su comportamiento será totalmente predecible:

int factor = 2;

var duplicate = static (int x) => x * factor; // Error CS8820: A static anonymous function

// cannot contain a reference to 'factor'.

var duplicate = static (int x) => x * 2; // Correcto, factor es un valor constante

var multiply = static (int x, int factor) => x * factor; // Correcto, factor se pasa como parámetro

Pero además, es importante saber que, cuando se invoca una lambda que captura alguna referencia externa, el compilador genera un objeto de cierre (o closure) para almacenar esas referencias, lo que implica una sobrecarga adicional en tiempo de ejecución y un mayor consumo de memoria.

Por tanto, cuando usemos lambdas estáticas, además de tener un código más seguro y determinista, podemos estar seguros de que no se generará ningún objeto de cierre, por lo que el rendimiento y consumo de memoria serán óptimos.

Benchmarks

El impacto del uso de objetos de cierre en el rendimiento y consumo de memoria puede ser significativo en escenarios donde se usan muchas lambdas que capturan referencias, como en bucles o en operaciones con colecciones. Esto puede verse en el siguiente resultado de un benchmark, donde comparamos cuatro escenarios diferentes:

- una lambda normal sin capturas,

- otra lambda normal que captura una propiedad de instancia,

- una tercera que captura una variable local,

- y una lambda estática sin capturas.

| Method | Mean | Error | StdDev | Median | Gen0 | Allocated |

|----------------------------- |----------:|----------:|----------:|----------:|-------:|----------:|

| NormalLambdaWithNoCapture | 0.0031 ns | 0.0033 ns | 0.0027 ns | 0.0023 ns | - | - |

| NormalLambdaWithCapture | 4.8063 ns | 0.0654 ns | 0.0612 ns | 4.8035 ns | 0.0077 | 64 B |

| NormalLambdaWithLocalCapture | 7.0980 ns | 0.1036 ns | 0.0969 ns | 7.0805 ns | 0.0105 | 88 B |

| StaticLambda | 0.0039 ns | 0.0035 ns | 0.0033 ns | 0.0046 ns | - | - |

Lo primero que llama la atención es que las lambdas normales que capturan referencias (ya sean de instancia o locales) son muchísimo más lentas que las que no capturan nada, y además generan consumo de memoria (reservan memoria en el heap y provocan recolecciones de basura).

Las lambdas que no capturan referencias prácticamente consiguen el mismo rendimiento, con una diferencia inapreciable. Y, eso sí, ninguna de las dos genera sobrecarga ni consumo de memoria.

Entonces, ¿cuándo deberíamos usar lambdas estáticas?

En general, salvo que necesitemos capturar referencias del contexto, será conveniente utilizar lambdas estáticas siempre, ya que nos aseguramos de que nuestro código es más seguro y predecible, sin perder en eficiencia o consumo de memoria.

Publicado en Variable not found.

Picando Código

List Category Posts v0.94.0 - Año nuevo, "vulnerabilidad crítica de seguridad" nueva

febrero 16, 2026 09:24

![]() Desde octubre la cosa estaba bastante tranquila en el frente List Category Posts, el plugin que desarrollé para WordPress. El año pasado empezaron los reportes de seguridad de supuestas vulnerabilidades del plugin. Inicialmente demoré demasiado en corregirlo, por lo que Wordfence alarmó a todos los usuarios de List Category Posts con una advertencia de que sufría de una vulnerabilidad.

Desde octubre la cosa estaba bastante tranquila en el frente List Category Posts, el plugin que desarrollé para WordPress. El año pasado empezaron los reportes de seguridad de supuestas vulnerabilidades del plugin. Inicialmente demoré demasiado en corregirlo, por lo que Wordfence alarmó a todos los usuarios de List Category Posts con una advertencia de que sufría de una vulnerabilidad.

La advertencia debió ser bastante alarmista, pero el peligro era prácticamente inexistente. Las vulnerabilidades no podían ser explotadas, a menos que el sistema ya estuviera comprometido y un atacante tuviera acceso al panel de administración. Documenté estas ocurrencias en varias ocasiones. En capítulos anteriores de Picando Código:

- Arreglada vulnerabilidad CVE-2025-47636 en List Category Posts

- Publicado List Category Posts v0.92.0 con mejoras en "seguridad"

- Nada que ver en las audaces aventuras de desarrollar un proyecto de código abierto popular

- List Category Posts v0.93.0 donde se corrigen "problemas" y re-aprendo PHP

En fin, acá estamos de nuevo con otra ocasión donde se reportaron nuevos problemas. Mientras corregía uno, me llegó otro correo de Wordfence con otro similar, y eventualmente el mismo reportado por Patchstack. Está bueno esto de entender cómo funciona el proceso en el que se informa responsablemente de un CVE con su ID, puntaje y demás. Este último tiene el id CVE ID: CVE-2026-0553.

A partir de hoy está disponible List Category Posts v0.94.0, que corrige dos "vulnerabilidades" que realmente no lo son tanto. Ya que estaba decidí actualizar otra parte del código, a ver si resuelve un problema reportado en el foro que no pude reproducir en mi ambiente de desarrollo.

Escribí el código medio rápido porque lo quería sacar cuanto antes. Pero por suerte está Klemens que ha aportado un montón de código y se acuerda de cosas que yo no. Siempre lo menciono en los Pull Requests porque respeto mucho su opinión y generalmente sabe más que yo de PHP y WordPress. Probé el código en local y confirmé que las vulnerabilidades reportadas habían sido resueltas sin romper nada en general y que los tests pasan. Pero Klemens me recordó que ya había resuelto esos mismos problemas anteriormente. Así que gracias a su revisión del código, lo mantuve más consistente con lo que había hecho en ocasiones anteriores.

El plugin tiene un puntaje muy bueno en el rating de WordPress.org, 4.7 de 5. La mayoría de los usuarios están bastante contentos, y eso está bueno. Se me dio por ir a mirar si había algo nuevo, y de hecho encontré una reseña escrita hace algo más de un mes que me dejó muy contento.

Titulada "Fantastic", la reseña dice: Este es un plugin absolutamente asombroso porque se puede usar de tantas formas diferentes desde por ejemplo crear una página de navegación que lista las páginas categorizadas con "Navegación", a crear "Páginas relacionadas", etc. Hasta puede usarse con etiquetas, no sólo categorías. Y más. Es la idea, por más que empezó como una herramienta que uso para mi blog, poder compartirla y hacerle la vida más fácil a otra gente con el mismo código.

Wordfence generalmente me enviaba el reporte por email. Pero recientemente publicaron un portal para gestionar vulnerabilidades. Asumí que por ahí venía la mano de tanto reporte. Por su lado tienen un interés comercial. Por el de nuestro plugin, todo el trabajo es voluntario y por el simple hecho de compartirlo con la comunidad. Mi respuesta inicial fue que no quería crearme una cuenta más en internet, si era posible que me avisaran por correo de todas formas. Después de un tiempo me convencieron. Pero intenté hacerme una cuenta, y no funcionaba el token que me habían mandado, así que me dí por vencido.

Me volvieron a convencer más recientemente y creé una cuenta. Ahora sólo tenía que agregar mis plugins de WordPress y verificar que eran míos. Por alguna razón, el sistema detecta que el código está en GitHub, y me pide que suba un archivo a la raíz del dominio para verificar que soy el dueño del código... Sí, me pide que suba un archivo de texto a la raíz de github.com. Estamos en 2026 y estas cosas salen a producción. Una empresa de expertos en seguridad. Les escribí al respecto, pero creo que decidieron ignorarlo y no me han dicho nada. Pero bueno, seguiré pidiendo que me manden los reportes por correo electrónico como se debe...

List Category Posts es un plugin para WordPress, es software libre publicado bajo la GPLv2. El código fuente está disponible en Codeberg, en GitHub y en WordPress.org (SVN). Se puede descargar desde el sitio de plugins de WordPress.

El post List Category Posts v0.94.0 - Año nuevo, "vulnerabilidad crítica de seguridad" nueva fue publicado originalmente en Picando Código.Variable not found

Enlaces interesantes 637

febrero 16, 2026 07:31

Mucho contenido interesante en la recopilación de enlaces de esta semana, entre los que me gustaría destacar algunas lecturas a las que, como mínimo, vale la pena echar un vistazo.

Ha llegado la primera preview de .NET 11, con un buen puñado de novedades en el runtime, librerías, SDK, C#, ASP.NET y Blazor. En el post del anuncio oficial podéis encontrar el listado completo y enlaces para profundizar en cada una de ellas.

Tenemos un doblete de Ricardo Peres sobre Entity Framework Core. Primero, profundiza en la forma de mapear distintos tipos de relaciones y las novedades que se han introducido en las últimas versiones para facilitar esta tarea, y luego nos habla sobre la validación de estado de entidades en este framework.

GitHub Copilot es indudablemente una herramienta alucinante, pero a veces no es fácil saber qué modo de uso es el más adecuado para cada tarea. José Manuel Alarcón nos lo explica en este artículo.

Y siguiendo con dobletes, el mismo autor nos trae un interesante artículo analizando cómo determinadas narrativas negativas amplificadas en redes sociales pueden generar frustración y malas decisiones en desarrolladores júnior, y propone estrategias prácticas para reconocer ese sesgo y protegerse de él.

Por último, James Randall comparte cómo ha cambiado la programación en 40 años y cómo ha cambiado también su relación con ella. Si tienes ya unos añitos, probablemente te sentirás identificado.

El resto de enlaces, a continuación.

Por si te lo perdiste...

- Invalidar el contenido cacheado por el tag helper "cache" de ASP.NET Core MVC

José M. Aguilar - Abrir Gmail y Google Calendar con una cuenta específica, y cómo anclarlos en la barra de tareas de Windows

José M. Aguilar

.NET

- .NET 11 Preview 1 is now available!

.NET Team - Autentication y Authorization en .NET

Fernando Escolar - Abstract Factory vs Factory Method Pattern in C#: Key Differences Explained

Nick Cosentino - Global Phone Number and Postal Code Validation Made Easy

David McCarter - Implementing strongly-typed IDs in .NET for safer domain models

Ali Hamza Ansari - How to Start a New .NET Project in 2026

Anton Martyniuk - Automatic Service Discovery in C# with Needlr: How It Works

Nick Cosentino - Writing a .NET Garbage Collector in C# - Part 7: Marking handles

Kevin Gosse

ASP.NET Core / ASP.NET / Blazor

- ASP.NET Core Security Explained: Modern Authentication, Authorization, and JWT

Arulraj Aboorvasamy - Isolate the swiyu Public Beta management APIs using YARP

Damien Bowden - Secure Image Uploads in Blazor Rich Text Editor Using JWT

Saravanan G. - Customizing Validation Messages in Blazor Forms

Héctor Pérez - Mastering the ASP.NET Core Request Pipeline: Middleware, Endpoint Filters, and Scalable API Architecture

Sudhir Mangla - Implementing Zero Trust with Resource Isolation

Maarten Balliauw - Announcing Blazorise 2.0

Mladen Macanović

Azure / Cloud

- Cloudflare for Startups: Hasta 250.000 USD en servicios para tu proyecto

Chema Alonso - Announcing Application Insights SDK 3.x for .NET

MattMC

Data

- Cuando usar FindAsync o FirstOrDefaultAsync en EF Core

Gerson Azabache Martínez - Modern Mapping with EF Core & EF Core State Validation

Ricardo Peres - How LeftJoin and RightJoin Work in EF Core .NET 10

David Grace - Entity Framework Core 10 provider for Firebird is ready

Jiří Činčura - SQL SERVER – Execution Plans and Indexing Strategies – Quick Guide

Pinal Dave - Azure SQL’s Native JSON Type: Optimized for Performance

Shrusti Kolsur - Stop Hoarding Personal Data in Entity Framework

Martin Stühmer

Machine learning / IA

- Haz que tus custom agents sean subagents de GitHub Copilot

Gisela Torres - Building an AI Skills Executor in .NET with Azure OpenAI

Rand Random - Microsoft Agent Framework: Exposing an Existing AI Agent as an MCP Tool – Jamie Maguire

Jamie Maguire - Testing ads in ChatGPT

OpenAI

Web / HTML / CSS / Javascript

- Announcing TypeScript 6.0 Beta

Daniel Rosenwasser - Trying to Make the Perfect Pie Chart in CSS

Juan Diego Rodríguez - What to Expect in Angular 22

Kelly Vatter - Integrating HTMX with React and Next.js for Dynamic HTML Updates

Satheeskumar S. - How to Open and Render DOCX Files in the Browser with React

Ramkumar Ravy - Approximating contrast-color() With Other CSS Features

Kevin Hamer - Image Optimization in Angular Applications

Christian Nwamba - Making a Responsive Pyramidal Grid With Modern CSS

Temani Afif

Visual Studio / Complementos / Herramientas

- GitHub Copilot: cuándo usar los modos Ask, Edit, Agent y Plan según la tarea

José Manuel Alarcón - 5 open-source Windows 11 apps you didn't know you needed

Mauro Huculak - How to Convert an HTML to an EXE file

Alex Marin - GitHub Copilot Testing for .NET Brings AI-powered Unit Tests to Visual Studio 2026

McKenna Barlow - Unlock language-specific rich symbol context using new find_symbol tool

Mike Gine

.NET MAUI

- Visualizing Supply Chain Metrics in .NET MAUI with Charts and Gauges

Hariram Subramanian - Why Your .NET MAUI Layout Breaks Across Devices and How to Fix It

Anandh Ganesan - Exploring Compiled Bindings in .NET MAUI

Leomaris Reyes - Building a Support Ticket Dashborad with .NET MAUI DataGrid

Farjana Parveen

Otros

- Desarrollador junior y frustrado con tu trabajo: cómo evitar el sesgo de negatividad online

José Manuel Alarcón - I Started Programming When I Was 7. I'm 50 Now, and the Thing I Loved Has Changed

James Randall

Picando Código

Números

febrero 05, 2026 10:30

Últimamente he ido identificando ciertos números "hito" tanto en este blog como en lo personal. Así que usé esos números como excusa para escribir.

Las ruinas de lo que queda de una comunidad rural de Drippan en Glen Finglas, Escocia.

En enero escribí mucho

En Enero de 2026, publiqué 16 entradas en el blog. Mirando el dropdown de archivos del blog, desde 2021 no escribía tantos posts en el mismo mes. En esa época estaba en pleno encierro post pandemia. Mentalmente me encontraba en un lugar bastante particular. Escribir en el blog era un escape y una forma de intentar conectar con el mundo exterior, aunque en su momento no tuve mucho éxito (estaba todo el mundo en un lugar particular en su cabeza).

Recientemente la motivación ha sido distinta. He estado escribiendo porque me gusta, porque tengo ganas y porque siento que tengo cosas para escribir. También he escrito cosas con las que estoy bastante conforme. Eso me motiva más a escribir y al estar en ese ritmo, me resulta más fácil y me surgen más ideas. Se ve que estoy en una etapa creativa, hay que seguir alimentándola. ¡Ojalá pudiera dedicarle más tiempo a proyectos creativos! Dijo toda persona con trabajo siempre.

El mes de febrero empezó bastante ocupadocon cosas fuera de la computadora así que recién estoy volviendo a escribir de nuevo. Tengo muchas cosas que quiero publicar, así que este fin de semana seguramente use un tiempo para ponerme al día.

Otra cosa que he notado en el blog es que han aumentado los comentarios, tanto en las entradas como a través de Mastodon. Muchas gracias a la gente que se toma el tiempo de dejar un comentario, es parte muy valiosa de un blog.

También veo los frutos de empezar a leer más blogs en español y conectar con más gente y directorios. Empiezo a sentir una ilusión de comunidad virtual como la que existía hace muchos años entorno a los blogs. Era cuestión de ponerle un poco de esfuerzo de nuevo. Por ejemplo leyendo un blog y reconociendo autores de otros blogs en los comentarios "¡A ese también lo leo!".

Números del blog

Al escribir esto tengo 317 entradas de borrador en el blog. Este año espero poder bajar ese número a algo más razonable. Muchas veces empecé a escribir algo y me quedé sin energía a mitad de camino, dejando un post sin terminar delegado al limbo de los borradores. Pero también estoy intentando no ser tan exigente con lo que publico. A veces unas pocas palabras sobre algo es mejor que nada, y me motiva a volver a escribir otra cosa más adelante. La constancia genera constancia.

Voy a tener que darme por vencido con un montón de cosas, eliminar el borrador y seguir adelante. Pero ya rescaté otro montón de entradas. Seguramente rescate alguna cosa más, y publique entradas que se puedan sentir "nostálgicas" llamémoslas porque las empecé hace años. Espero mantener esta constancia porque lo disfruto y me sirve de referencia para el futuro. Tengo borradores de 2008, algunos son sólo el título y no tengo ni idea qué quería escribir. Como experimento de repente hago una entrada a partir de esos borradores con tan poco contenido que ni idea por dónde venían. A ver qué sale.

Esta es la entrada 1784 en el blog. No es un número que se vea muy redondo, 1 + 7 es 8, 7 es primo y 8 y 4 son múltiplos de 2 y 2^2 y 2^3 respectivamente. Pero lo interesante es que la cosa se acerca a las 2.000 entradas. Veremos si llegamos. Estaría bueno celebrarlo de alguna manera, podría hacer sorteos del estilo que he hecho antes en el blog o algo más, pero me gustaría algo más interactivo. Si hice bien las cuentas, manteniendo un ritmo promedio de 9 entradas por mes en el blog, en 2 años estamos festejando esas 2.000 entradas.

Aproveché la movida de los números para escribir un poco de SQL y ver cuántos comentarios de usuarios hay (excluyendo pingbacks y trackbacks):

El resultado son 6862 comentarios de personas (incluyéndome). Casi 4 comentarios por entrada, ¡nada mal!

Cumpleaños de Picando Código

En junio de 2025, este blog cumplió 18 años en línea. Un montón de años para cualquier tipo de proyecto o página web. Es como una extensión de mi persona a esta altura. Me ha ido acompañando a lo largo de mi carrera, por etapas de más y menos constancia.

Bah, en verdad no es tanto una extensión de mi persona, sino una extensión del personaje de turno que esté a cargo en mi cabeza al momento de escribir cada entrada en el blog. De los delirion, opininones y sentimientos que elijo exponer públicamente a la internet a través de este medio. De distintos objetivos y motivaciones para escribir a lo largo de los años. Pero sí una expresión creativa que viene de mí.

Renové el dominio y hosting por un par de años más, así que el blog va a cumplir sus 20 años en línea en 2027. Si llega en línea al 2030, voy a haber vivido más años con Picando Código que años sin Picando Código. Quién sabe qué pasará en 2030, y si la vida en el planeta se sostiene hasta entonces con lo que viene pasando. Pero dejo acá una referencia en el tiempo, así tengo algo de qué escribir en 2030 y puedo hacer un flashback a esta entrada. Si leen esto y siguen acá entonces, pueden decir "¡yo me acuerdo de ese flashback!" en 2030.

Cumpleaños de Fernandito

En julio de 2025, cumplí 40 años, otro montón de años más. Qué buen año 1985, salió Super Mario Bros. y Volver al Futuro. No tengo mucho para escribir sobre el tema. Un mensaje que le daría a gente que va entrando a sus 30 es una advertencia que nunca me dieron. Los adultos nunca me avisaron que el pelo que perdemos en el cuero cabelludo crece en las orejas. Sí, a esta edad aparte de andar recortándose los pelos de la nariz, hay que afeitarse las orejas. Esta es parte importante de la sabiduría que he acumulado en mis primeras 4 décadas, por más a las órdenes, brebaje mediante.

Estamos en 2026, ¿se dan cuenta? 2025 no me sonaba tan especial porque es un múltiplo de 5 y siempre se sienten como puntos de referencia o fechas artificiales (cerebro funciona raro). Capaz mi mente está condicionada con los 5 porque me resulta fácil calcular mi edad en base a años que terminan en 5 (aparte de que sea la mitad del sistema decimal que usamos para todo). Pero 2026 se siente como un año bien en los dos miles.

Habiendo vivido el cambio de milenio, suena a año en pleno futuro. Estamos en el futuro y se siente como que de repente nos tendríamos que haber quedado con lo que teníamos al principio del milenio y no mucho más. Antes me preguntaba si tendríamos autos voladores y jetpacks. Ahora anhelo la abolición de los millonarios y que no se extinga la vida en el planeta a causa del capitalismo. Y dicen que uno se vuelve más conservador con la edad.

Creo que ya deliré suficiente con esto. Mejor la dejo acá...

Picando Código

Reemplazando Mozilla Firefox

enero 29, 2026 09:00

Como comenté en un post anterior, estoy dejando de usar Firefox. Una condición de este cambio es no usar un navegador web basado en el motor de Google Chrome. Google Chrome es el Internet Explorer 6 de éstos tiempos, así que quedan descartados un montón de navegadores web populares.

Hace tiempo que Mozilla parece estar buscando perder usuarios de Firefox de gusto. Pero el problema más notorio recientemente ha sido su compromiso con usar lo que los tecnofascistas millonarios cocainómanos de Sillicon Valley nos quieren vender a prepo con el término marketinero de "Inteligencia Artificial" ("IA" a partir de ahora, para acortar). Esto ha generado mucho rechazo (con razón) de una gran parte de sus usuarios. No quiero entrar en mi postura del tema de IA porque me entra a subir la presión y no es el tema de este post. Pero el consenso general parece ser que Mozilla debería preocuparse por hacer a Firefox el mejor navegador web posible, y no meterle IA a prepo.

Por suerte todavía hay muchas opciones, a continuación comento qué he ido haciendo. Potencialmente escriba más posts en el futuro sobre este tema. Definitivamente estoy prestando más atención recientemente al desarrollo de alternativas a Firefox, así que lo que vaya encontrando interesante lo compartiré por acá.

Descartado por ahora: GNU IceCat

GNU IceCat

En el pasado usé bastante IceCat, pero en algún momento dejaron de funcionar los repositorios o algo de eso. Tengo una instalación vieja en el directorio ~/bin de mi sistema, pero aparentemente no tiene la habilidad de actualizarse sólo a versiones más nuevas. Hace muchos años hasta escribí un post Usando IceCat como reemplazo de Mozilla Firefox: Perfiles de usuario. Esto de llevarme el perfil a otro navegador me puede resultar útil, pero ya veremos más adelante...

La página web de GNU IceCat dice: El proyecto actualmente no distribuye binarios, pero el gestor de paquetes GNU Guix puede ser usado para instalar IceCat en sistemas GNU/Linux. También hay instrucciones para hacer tu propia versión de IceCat con scripts del repositorio git de GNUzilla y el código fuente de Firefox. Todo bien, en algún momento de repente me interesaría aprender y probar Guix. Y compilar el código puede llegar a ser divertido. Pero en este momento estoy intentando reemplazar Firefox y no tengo tiempo.

Aparentemente sólo hay binarios de versiones no oficiales, y no encontré un PPA confiable como para agregar a APT. Hay uno con versiones arcaicas de IceCat que creo que lo encontré buscando en este mismo blog. Pero en fin, queda descartado porque no me inspira demasiada confianza su futuro. De repente con la cantidad de usuarios que nos vamos yendo de Firefox es un buen momento para volcar más recursos en el mantenimiento de IceCat, pero parece que ahora no es prioridad. Si remonta un poco la actividad, lo volveré a considerar.

Debian Iceweasel

Debian Iceweasel

En mi búsqueda pensé si no sería un bueno momento también para que vuevla Iceweasel. Entre Debian Etch y Debian Jesse la versión de Firefox empaquetada por Debian llevaba el nombre de Iceweasel. Esto era para no infringir con la marca registrada de Mozilla. El Firefox que venía en Debian no era "oficial", le aplicaban sus propios parches y cambios al navegador. Mozilla consideraba estos cambios fuera de su política, así que el paquete no se podía considerar "Firefox".

Más adelante Debian fue autorizado a volver a la marca de "Firefox" y Iceweasel desapareció. Esto es lo que recuerdo, pero seguramente falten muchos detalles. Sé que hay hasta una entrada en Wikipedia sobre la pelea por la marca registrada de Firefox entre Mozilla y Debian para leer más del tema.

Debian igual hace algunos cambios a la configuración por defecto de Firefox en su versión .deb. En esta wiki hay más detalles, aunque está muy desactualizada. Ahí mismo comentan: "Firefox hace una serie de conexiones automatizadas a servidores de Mozilla (y de otros) sin pedir la aprobación explícita del usuario". Así que están pendientes de la telemetría y los problemas de privacidad de Firefox.

Es posible que en algún momento consideren que el desarrollo de Firefox diverge tanto de lo que es aceptable en Debian, que decidan volver a hacer su propia versión. Ya hay un bug reportado de 2025 donde cuestionan que los nuevos términos de uso de Firefox sean compatibles con Debian. En la conversación está Sylvestre Ledru, desarrollador de Debian desde hace muchos años y director en Mozilla, involucrado en su momento con el tema Iceweasel/Firefox. También Mike Hommey, uno de los desarrolladores más prolíficos de Mozilla en número de commits, empleado de Mozilla y quien estuvo manteniendo Firefox/Iceweasel en Debian muchos años.

Sería interesante, veremos qué pasa. Tanto hablar de Debian me dieron ganas de volver a Debian...

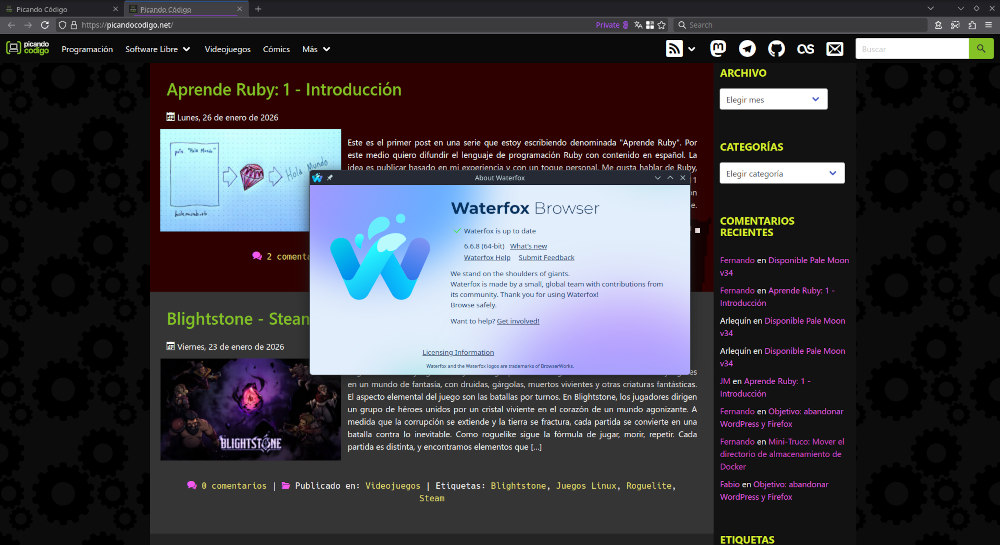

Waterfox y LibreWolf

De la poca investigación y lo que he fui leyendo, éstos dos parecen ser los forks más populares de Firefox éstos días. Instalé ambos, pero a lo que empecé a usar Waterfox y todo funcionó bien, me quedé con eso. Tengo instalado LibreWolf, pero sinceramente no lo he usado mucho.

Waterfox

Waterfox

Encontré una guía de instalación que usaba el repositorio APT de OpenSUSE (Hola OpenSUSE, ¡tanto tiempo!). Pero poco después me enteré que el repositorio dejó de ser mantenido, así que no recibiría más actualizaciones. Así que descargué el binario para Linux desde la página web oficial y desinstalé el deb. Por suerte todo siguió igual, la versión instalada a mano levantó el mismo perfil que la anterior.

También lo instalé en mi teléfono y lo sincronicé con la versión del escritorio. Todo funcionó bien. Pensé en hacer lo que comentaba en la sección de IceCat, de importar mi perfil de Firefox y mantener la experiencia. Pero aproveché la oportunidad para empezar de cero y tener una experiencia limpia.

Me importé todos los Favoritos (o Bookmarks) de Firefox. Instalé sólo un par de extensiones, ya ni recuerdo cuáles venían instaladas y cuáles no. Pero esenciales son uBlockOrigin y una que descubrí gracias a FireDragon: Dark Reader. Agrega la opción de tener "modo oscuro" para cualquier página, muy conveniente para no quedar encandilados en páginas con fondo blanco. Ya no puedo usar el escritorio de WordPress sin Dark Reader...

Desde que Mozilla paró el desarrollo de Lockwise, migré mis contraseñas a Bitwarden. Instalé la extensión de Bitwarden para mis passwords, y listo. En principio tenía Firefox Nightly y Waterfox funcionando a la vez. Entonces si necesitaba algo de Firefox me lo traía a mano. Pero hace bastante ya que no necesito abrir Firefox.

Personalicé un poco la interfaz de usuario a mi gusto. Creo que por defecto traía la barra de estado, algo medio old school que ocupa un poco de espacio en la parte inferior de la pantalla. De ahí saqué el botón para sacar capturas de pantalla, una herramienta que uso seguido, y lo moví a la barra superior junto al menú de favoritos y extensiones.

Creé varios contenedores, un invento excelente de Mozilla cuando todavía eran buenos. Me creé contenedores específicos para servicios, por ejemplo todo lo que sea de Google corre en su contenedor. Con la opción de abrir siempre esas páginas en el contenedor, no tenemos ni que pensar. Aproveché la mudanza para usarlos mucho más y tener perfiles de navegación separados dentro del mismo navegador.

Una característica genial de Waterfox es que te permite abrir pestañas privadas en la misma ventana de navegación que estás usando para las pestañas comunes. Hasta donde sé, Firefox no tenía esta característica, sólo abrir enlaces en ventanas nuevas privadas.

Waterfox publicó en su blog una respuesta directa al uso de IA por Mozilla: No AI* Here - A Response to Mozilla's Next Chapter. La parte que concierne a inclusión de AI en el navegador se resume en "Waterfox no incluirá LLMs. Punto y aparte. Al menos y definitivamente no en su forma actual ni en el futuro previsible".

Después de esos primeros días donde personalicé y dejé el navegador a gusto, todo viene funcionando bien, como esperaba. No noto muchas diferencias con Firefox, de repente anda mejor, pero puede ser porque en Firefox tengo cientos de pestañas abiertas, algunas de hace muchos años... Y el perfil de usuario lo vengo arrastrando hace años en distintas versiones de Firefox y de Sistemas Operativos. Uh, otra cosa que agregaron en la última versión de Waterfox que está muy buena es "des-cargar" pestañas (des cargar onda de sacarlas de la memoria) desde el menú contextual. Hacemos clic derecho en una pestaña y nos aparece la opción.

El paso que me queda es un día sentarme a recorrer todas esas pestañas que tengo abiertas en Firefox, exportar a favoritos las cosas que quiere leer o volver a visitar, y cerrar el resto. Así finalmente voy a poder desinstalar Firefox y olvidarme del tema. Pero como navegador principal por ahora vengo usando Waterfox y estoy conforme.

LibreWolf

LibreWolf

Como mencioné, no llegué a usar mucho LibreWolf. Pero no veo por qué no sería una buena opción para reemplazar Firefox.

Es un fork popular y sus metas son la privacidad, seguridad y libertad de los usuarios. Está diseñado para mejorar la protección contra técnicas de rastreo y fingerprinting, e incluye mejoras de seguridad a través de opciones por defecto y parches. También elimina toda la telemetría, colección de información y molestias, y deshabilita características anti-libertad como DRM. Esto último podría ser un problema a la hora de usar servicios de streaming imagino, pero seguro hay alguna vuelta para solucionarlo.

Incluye uBlockOrigin por defecto, esa extensión esencial. Hace años que no tengo ni idea cómo se ven los anuncios en la web, y cada vez que veo uno en la pantalla de otra persona me agobio. El gestor de contraseñas viene deshabilitado, recomiendan usar un gestor mejor y entre las opciones sugieren Bitwarden.

Su repositorio de código está alojado en Codeberg. No tienen versión de Android, pero recomiendan IronFox como alternativa, un proyecto que voy a revisar y tener en cuenta.

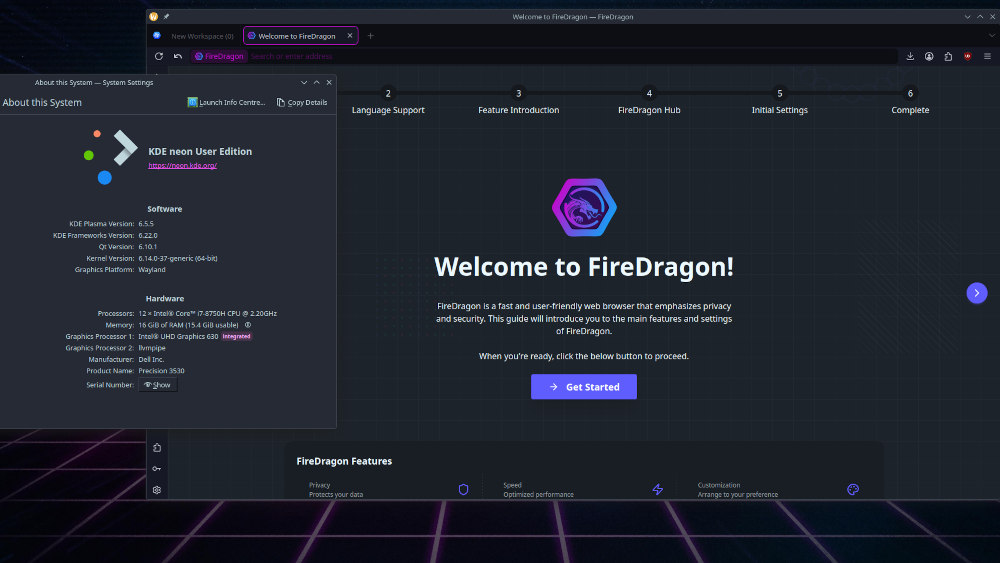

FireDragon (Garuda Linux)

FireDragon

Además de KDE Neon como distribución principal, también vengo usando Garuda Linux. En ese sistema no tuve que hacer nada porque el navegador web por defecto es FireDragon:

FireDragon es un navegador basado en el excelente navegador Floorp (también llamado el Vivaldi de los Firefox). Fue personalizado para tener una estética similar al sistema así como muchas preferencias opinionadas por defecto. Como este navegador era originalmente un fork de Librewolf, estamos tratando de integrar sus mejores parches y cambios en la base nueva.

Floorps es otra opción a tener en cuenta, pero en lo personal no me interesó. Tienen una postura definida, distinta a Mozilla, en cuanto al uso de IA: No respaldamos completamente ni rechazamos explícitamente IA. Respetamos las decisiones de los usuarios que quieren usar IA y de los que no. Cualquier característica de IA agregada a Floorp será en base de optar por usarlo. Van a estar desactivados a menos que sean habilitados por el usuario.

A tener en cuenta, en esa misma página hacen un comentario bastante ridículo: Para mantener un paso de desarrollo que soporte a usuarios en todo el mundo, es esencial la asistencia de herramientas de IA (como GitHub Copilot). Si van a usar esas porquerías, háganse cargo, no salgan con ese bolazo de que es "esencial".

Además de las preferencias de Floorps, FireDragon tiene un montón de personalizaciones. Cuenta con Firefox accounts pero usa un servidor de sincronización a medida. Un detalle visual es que cuando un botón está deshabilitado (por ejemplo los botones de navegación adelante y atrás si no hay nada adelante o atrás), desaparecen en vez de quedar en color gris. Si bien es el navegador de Garuda Linux, se puede instalar en otros sistemas. Está disponible en AUR, NixOS, Flatpak, AppImage y binarios para Linux y los otros sistemas privativos.

FireDragon, el navegador web de Garuda Linux (ArchLinux) corriendo en KDE Neon (Ubuntu)

Tor Browser

Tor Browser

Tor Browser es el navegador web del proyecto Tor. Si no conoces el proyecto Tor y el navegador, este es un buen lugar para empezar. La misión de Tor es:

Promover los derechos humanos y las libertades mediante la creación y despliegue de tecnologías de anonimato y privacidad libres y de código abierto, el apoyo a su disponibilidad y utilización sin restricciones y el fomento de su comprensión científica y popular.